Cara Menggunakan GPT-5 di Produksi: Panduan API, Routing, dan Optimasi Biaya untuk Developer 2025

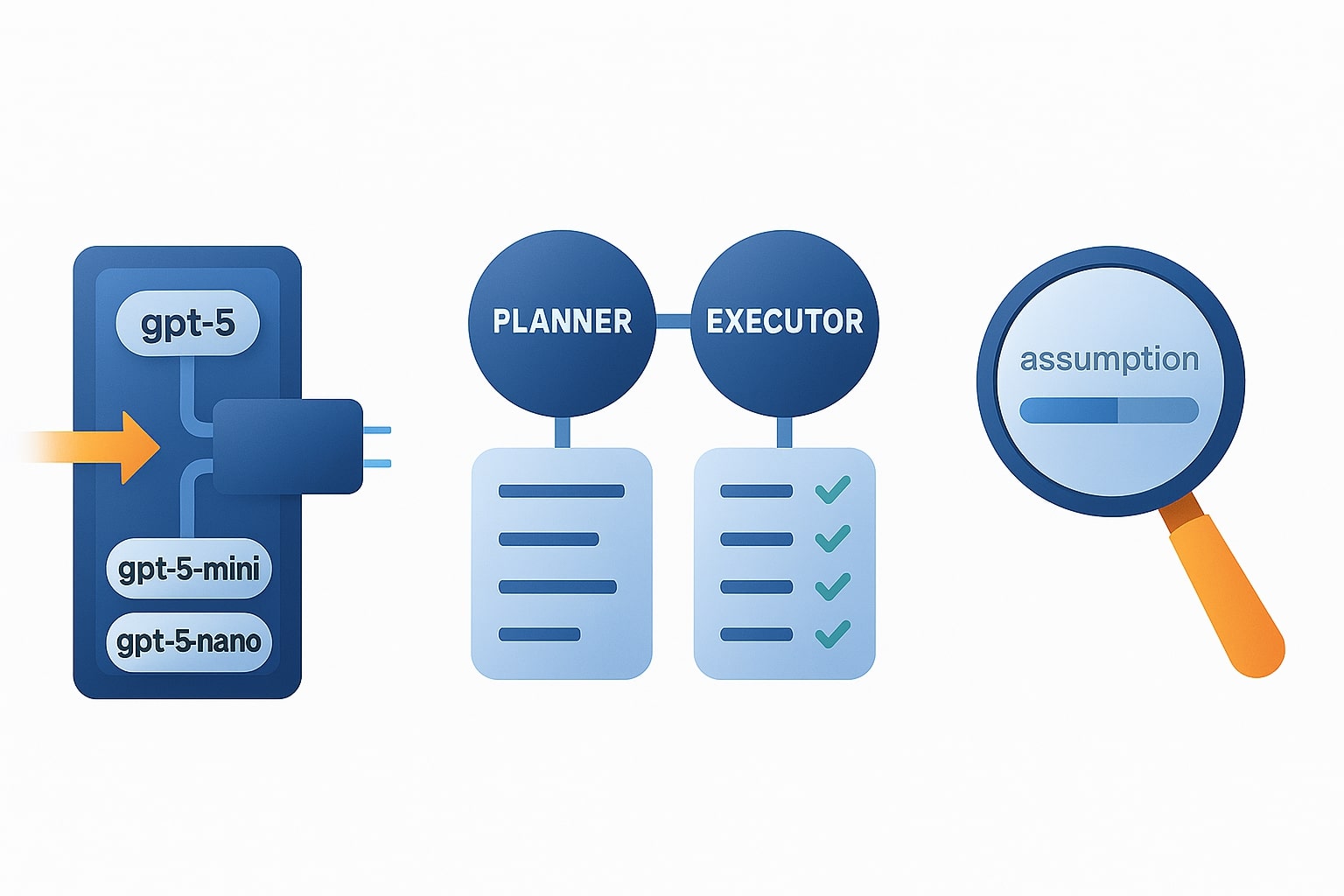

Di 2025, GPT-5 bukan sekadar chatbot—tapi mesin inti di sistem produksi. Dengan arsitektur terpadu dan varian model (gpt-5, mini, nano), GPT-5 memungkinkan developer membangun aplikasi cerdas dengan latensi rendah, biaya terkendali, dan penalaran mendalam saat dibutuhkan.

- Gunakan Responses API: Gantilah Chat Completions dengan Responses API—antarmuka modern yang menyatukan structured outputs, tool calling, streaming, dan reasoning control dalam satu endpoint.

- Control penalaran: Atur reasoning.effort ke minimal, medium, atau high tergantung kompleksitas tugas—hemat biaya dan latensi untuk permintaan sederhana.

- Structured Outputs: Paksa model mengembalikan JSON sesuai skema. Hilangkan parsing manual dan kurangi error di downstream pipeline.

- Tool calling yang aman: Definisikan fungsi eksternal, batasi jumlah panggilan, dan proses dalam dua langkah: (1) minta argumen, (2) kirim hasil alat kembali ke model.

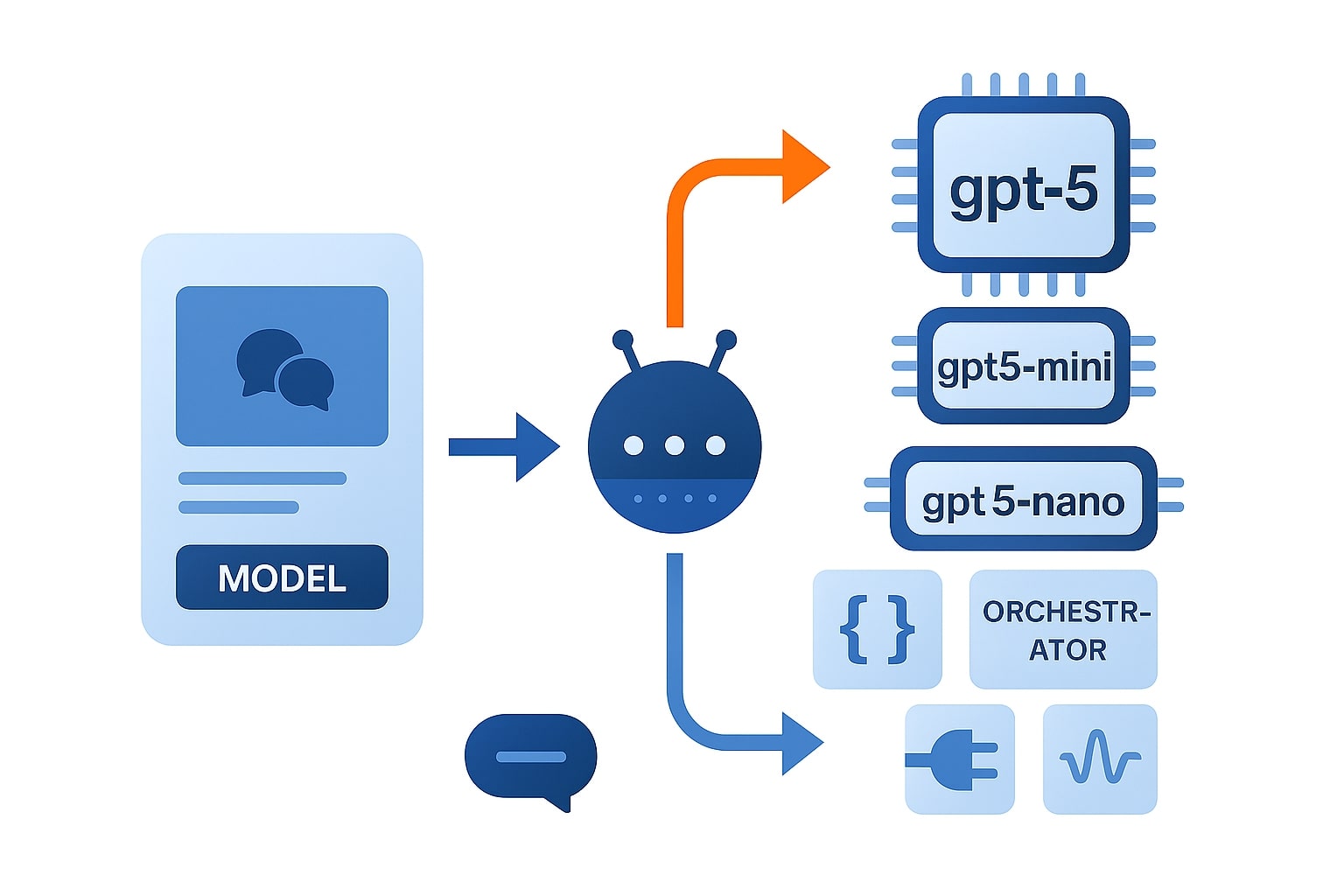

- Router model cerdas: Rute tugas ke gpt-5-nano (real-time), gpt-5-mini (umum), atau gpt-5 (kompleks) berdasarkan kompleksitas, latensi, dan kebutuhan alat.

- Optimasi biaya: Manfaatkan prompt caching dengan menjaga awalan instruksi stabil, dan gunakan max_output_tokens untuk batasi panjang respons.

- Streaming ke UI: Tampilkan hasil secara real-time ke pengguna dengan event streaming di Next.js, React, atau framework frontend lainnya.

- Observabilitas: Log model, token, latensi, dan request ID untuk monitoring, debugging, dan optimasi berbasis data.

Strategi terbaik? Jangan selalu pakai GPT-5 utama. Gunakan kombinasi planner-executor atau verifikasi ringan untuk tekan biaya tanpa korbankan kualitas. Baca panduan lengkapnya di sini.

Margabagus.com – Subuh tadi, alarm on call membangunkan saya, grafik latensi melonjak, log menumpuk, notifikasi berdenting. Saya menyalakan GPT-5 melalui Responses API, bukan untuk menulis esai, tetapi untuk memilah ratusan ribu baris log yang saling silang. Karena GPT-5 menerima konteks hingga sekitar empat ratus ribu token, saya bisa menempelkan potongan panjang tanpa memotong cerita. Putaran pertama saya jalankan dengan gpt-5-mini agar cepat dan hemat, cached input membantu memangkas biaya untuk instruksi yang berulang. Setelah pola awal muncul, saya naikkan ke gpt-5 dan meminta penalaran lebih dalam dengan effort medium, hipotesis diuji, asumsi ditandai, dan rute mitigasi disusun. Saat matahari naik, kami sudah punya ringkasan insiden yang bisa dipresentasikan, lengkap dengan daftar mitigasi dan rencana uji balik.

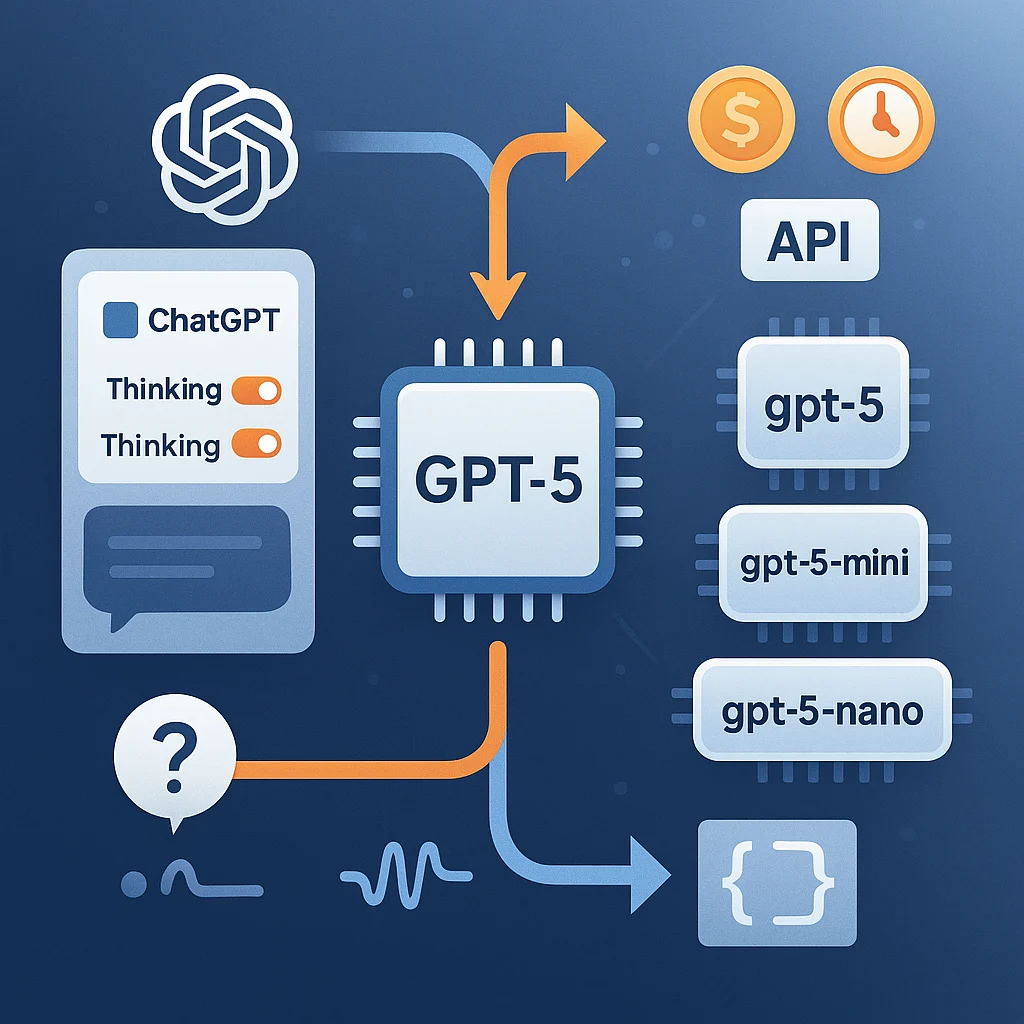

Dari ChatGPT ke API, jalurnya begini

Di ChatGPT, GPT-5 menjadi pengalaman default. Anda bisa memilih secara manual melalui pemilih model, GPT-5 untuk mayoritas tugas, GPT-5 Thinking untuk kasus yang membutuhkan penalaran lebih dalam, GPT-5 Thinking Pro bagi pelanggan tertentu seperti Pro dan Team. Ada batas pemakaian per tier, ketika Anda menyentuh batas, percakapan akan menggunakan varian mini hingga jatah Anda kembali, ini normal dan membantu menjaga ketersediaan. Di sisi Enterprise dan Edu, ketersediaan penuh sering menyusul gelombang peluncuran, jadi selalu cek pengumuman terbaru di pusat bantuan.

Di API, jalurnya lebih eksplisit. Anda memilih model sesuai kebutuhan aplikasi, gpt-5, gpt-5-mini, gpt-5-nano. Gunakan Responses API agar alur kerja lebih seragam, instruksi, tool calling, structured outputs, dan streaming berada dalam satu antarmuka yang konsisten. Chat Completions masih tersedia, namun Responses semakin menjadi standar karena fleksibilitas event streaming dan kemudahan memanen keluaran final tanpa parsing yang rapuh. Bila Anda memakai Assistants, prinsipnya sama, hanya saja orkestrasi tool dan state dikelola oleh layanan itu.

Parameter yang paling berpengaruh di produksi

Saya menganggap tiga hal paling menentukan stabilitas, cara Anda mengatur penalaran, cara Anda memaksa format, dan cara Anda mengendalikan alat.

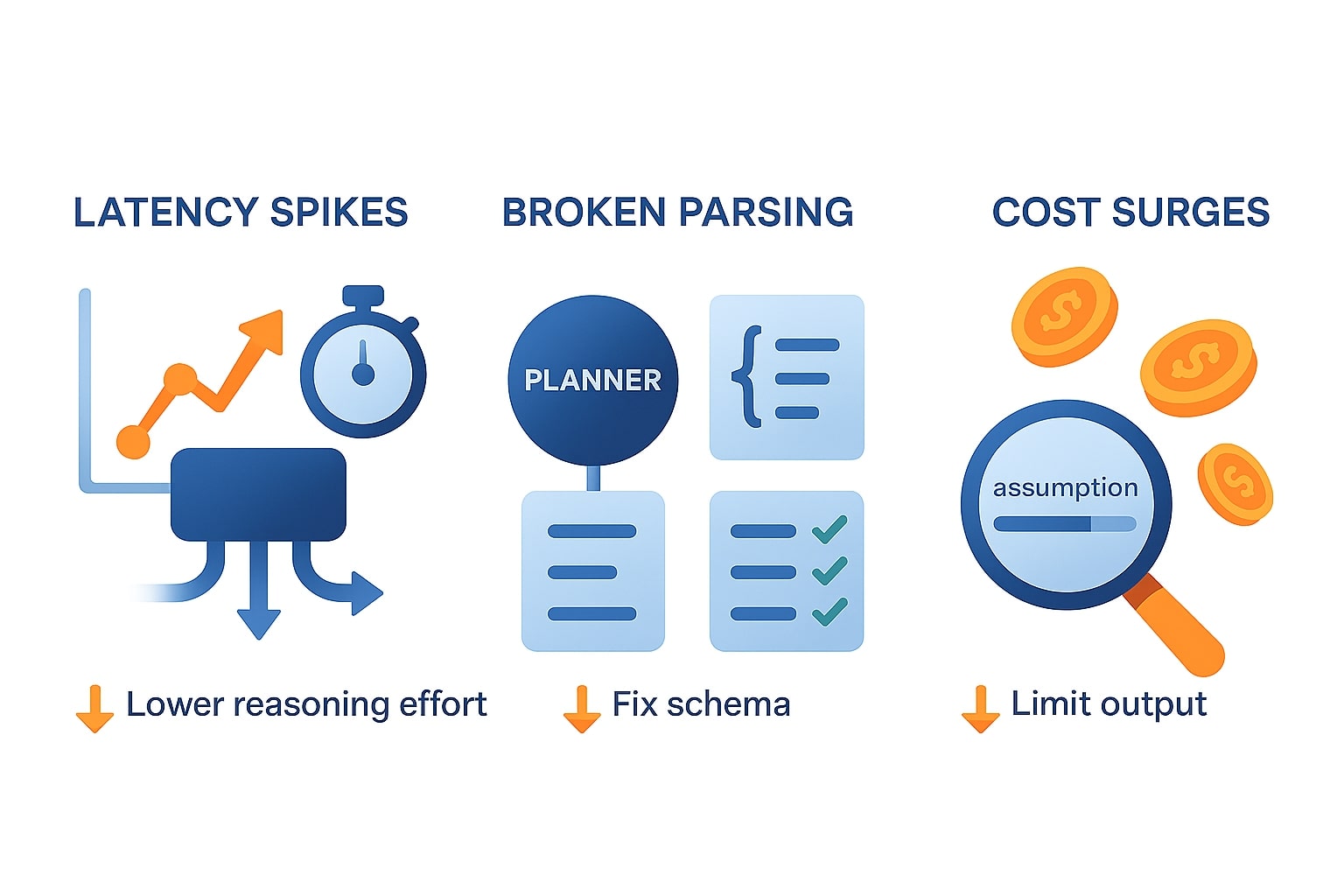

Pertama, penalaran. GPT-5 menyediakan pengaturan untuk mengarahkan seberapa panjang upaya penalaran yang dikeluarkan model. Dalam panggilan API, Anda bisa memberi petunjuk melalui bidang reasoning, effort minimal, medium, atau high. Minimal untuk tugas yang jelas dan singkat, medium untuk keseimbangan, high ketika Anda mengejar akurasi pada masalah yang sangat sulit. Dalam praktik, saya memulai dari medium untuk endpoint publik, lalu menurunkan atau menaikkan berdasarkan latensi dan tingkat kesalahan yang saya ukur.

Kedua, format. Structured Outputs membantu Anda memaksa keluaran mengikuti JSON Schema yang Anda tetapkan. Ini mengurangi biaya perekat, tidak perlu regex yang rapuh, dan menurunkan kasus error pada pipa hilir. Saya mendorong tim untuk mulai dari skema kecil, tambahkan properti secara bertahap, dan berikan deskripsi yang jelas pada setiap field agar model memahami maksud Anda.

Ketiga, alat. Tool calling, atau function calling, memungkinkan model memanggil fungsi yang Anda sediakan. Anda dapat mengatur tool_choice, otomatis, paksa satu alat tertentu, atau nonaktifkan pemanggilan. Di GPT-5, perilaku ini lebih hemat panggilan dibanding generasi sebelumnya, tetapi tetap bijak memberi guardrail, batasi jumlah panggilan beruntun, tambahkan timeout yang realistis, dan log setiap argumen yang diusulkan model.

Baca artikel menarik lainnya: GPT-5: Varian, Kegunaan, dan Mana yang Tepat untuk Anda di 2025

Potongan kode yang ringkas, supaya cepat jalan

Berikut contoh yang cukup untuk menyalakan endpoint GPT-5 dengan Responses API. Sintaks dapat berbeda antar SDK, namun strukturnya serupa.

curl https://api.openai.com/v1/responses \

-H "Authorization: Bearer $OPENAI_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-5",

"reasoning": {"effort": "medium"},

"input": [

{"role": "system", "content": "Anda adalah asisten teknis yang teliti"},

{"role": "user", "content": "Buatkan checklist verifikasi PR untuk microservice Go"}

]

}'

Contoh dengan Structured Outputs, skema kecil dulu agar mudah diuji.

curl https://api.openai.com/v1/responses \

-H "Authorization: Bearer $OPENAI_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-5-mini",

"reasoning": {"effort": "minimal"},

"input": [{"role": "user", "content": "Ekstrak 3 risiko utama dari teks berikut"}],

"response_format": {

"type": "json_schema",

"json_schema": {

"name": "risks",

"schema": {

"type": "object",

"properties": {

"items": {

"type": "array",

"items": {"type": "string"},

"minItems": 3,

"maxItems": 3

}

},

"required": ["items"],

"additionalProperties": false

}

}

}

}'

Contoh tool calling yang aman, batasi dan observasi.

curl https://api.openai.com/v1/responses \

-H "Authorization: Bearer $OPENAI_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-5",

"input": [{"role": "user", "content": "Ambil cuaca Jakarta hari ini"}],

"tools": [

{

"type": "function",

"function": {

"name": "get_weather",

"description": "Return weather by city name",

"parameters": {

"type": "object",

"properties": {"city": {"type": "string"}},

"required": ["city"]

}

}

}

],

"tool_choice": "auto"

}'

Bagian teknis tambahan untuk developer

Bagian ini untuk Anda yang ingin langsung menyalakan GPT-5 di produksi, saya sertakan contoh kode yang ringkas, pola streaming, cara memaksa format, pembacaan header rate limit, dan kiat biaya yang terverifikasi dari dokumentasi resmi.

Node.js, dari panggilan dasar hingga streaming

import OpenAI from 'openai'

const client = new OpenAI()

// Panggilan dasar, gunakan instruksi sebagai sistem, batasi keluaran

const r1 = await client.responses.create({

model: 'gpt-5',

instructions: 'Anda adalah asisten kode yang ringkas dan akurat',

input: [{ role: 'user', content: 'Tulis fungsi JS yang memformat tanggal ISO menjadi 11 Aug 2025' }],

max_output_tokens: 300

})

console.log(r1.output_text)

// Structured Outputs, paksa JSON Schema agar parsing stabil

const r2 = await client.responses.create({

model: 'gpt-5-mini',

input: 'Ekstrak 3 risiko utama dari teks ini, kembalikan hanya daftar string',

response_format: {

type: 'json_schema',

json_schema: {

name: 'risks',

schema: {

type: 'object',

properties: {

items: { type: 'array', items: { type: 'string' }, minItems: 3, maxItems: 3 }

},

required: ['items'],

additionalProperties: false

}

}

}

})

const { items } = JSON.parse(r2.output_text)

console.log(items)

// Streaming, tangkap potongan teks saat mengalir

const stream = await client.responses.create({

model: 'gpt-5-mini',

input: 'Sebutkan tiga langkah membuat health check untuk service Node',

stream: true

})

let text = ''

for await (const event of stream) {

if (event.type === 'response.output_text.delta') { process.stdout.write(event.delta); text += event.delta }

if (event.type === 'response.completed') { process.stdout.write('

') }

}

Python, pola yang sama, idiom yang bersih

from openai import OpenAI

client = OpenAI()

# Panggilan dasar

r1 = client.responses.create(

model='gpt-5',

instructions='Anda adalah asisten data yang teliti',

input=[{"role": "user", "content": "Buat SQL untuk agregasi penjualan per hari, kolom date dan revenue"}],

max_output_tokens=300,

)

print(r1.output_text)

# Structured Outputs, JSON Schema

r2 = client.responses.create(

model='gpt-5-mini',

input='Ekstrak nama produk dan harga dari paragraf ini',

response_format={

'type': 'json_schema',

'json_schema': {

'name': 'products',

'schema': {

'type': 'object',

'properties': {

'items': {

'type': 'array',

'items': {

'type': 'object',

'properties': {

'name': {'type': 'string'},

'price': {'type': 'number'}

},

'required': ['name','price'],

'additionalProperties': False

}

}

},

'required': ['items'],

'additionalProperties': False

}

}

}

)

print(r2.output_text)

# Streaming, dengarkan jenis event yang relevan

s = client.responses.create(model='gpt-5-mini', input='Tiga prinsip idempotensi pada API', stream=True)

for event in s:

if event.type == 'response.output_text.delta':

print(event.delta, end='')

if event.type == 'response.completed':

print('

')

Tool calling yang terkendali, contoh dua langkah

Gunakan tool_choice untuk membiarkan model memutuskan, atau paksa alat tertentu. Setelah model mengusulkan argumen, jalankan fungsi Anda, lalu panggil kembali API dengan hasil alat agar model menutup jawaban.

// Definisikan alat

const tools = [{

type: 'function',

function: {

name: 'get_weather',

description: 'Kembalikan cuaca berdasarkan nama kota',

parameters: { type: 'object', properties: { city: { type: 'string' } }, required: ['city'] }

}

}]

// Langkah 1, minta argumen

const first = await client.responses.create({ model: 'gpt-5', input: 'Cuaca Jakarta hari ini', tools, tool_choice: 'auto' })

const call = first.output?.find(o => o.type === 'tool_call')

// Langkah 2, jika ada tool_call, jalankan fungsi lalu kirim kembali hasilnya

if (call) {

const weather = await get_weather(JSON.parse(call.arguments).city)

const second = await client.responses.create({

model: 'gpt-5',

input: [

{ role: 'user', content: 'Cuaca Jakarta hari ini' },

{ role: 'tool', name: 'get_weather', content: JSON.stringify(weather) }

],

})

console.log(second.output_text)

}

Baca header rate limit, lakukan retry dengan tenang

API mengembalikan header seperti x-ratelimit-remaining-requests, x-ratelimit-remaining-tokens, dan waktu reset. Terapkan backoff eksponensial, hormati retry-after, catat x-request-id untuk pelacakan.

async function withRetry(fn, max=5) {

let attempt = 0

while (true) {

try { return await fn() } catch (err) {

const res = err.response

const retryAfter = Number(res?.headers?.['retry-after'] ?? 0)

if (res?.status !== 429 || attempt++ >= max) throw err

const backoff = Math.max(retryAfter * 1000, 1000 * 2 ** attempt)

await new Promise(r => setTimeout(r, backoff))

}

}

}

const response = await withRetry(() => client.responses.create({ model: 'gpt-5-mini', input: 'ping' }))

console.log('request id', response._request_id)

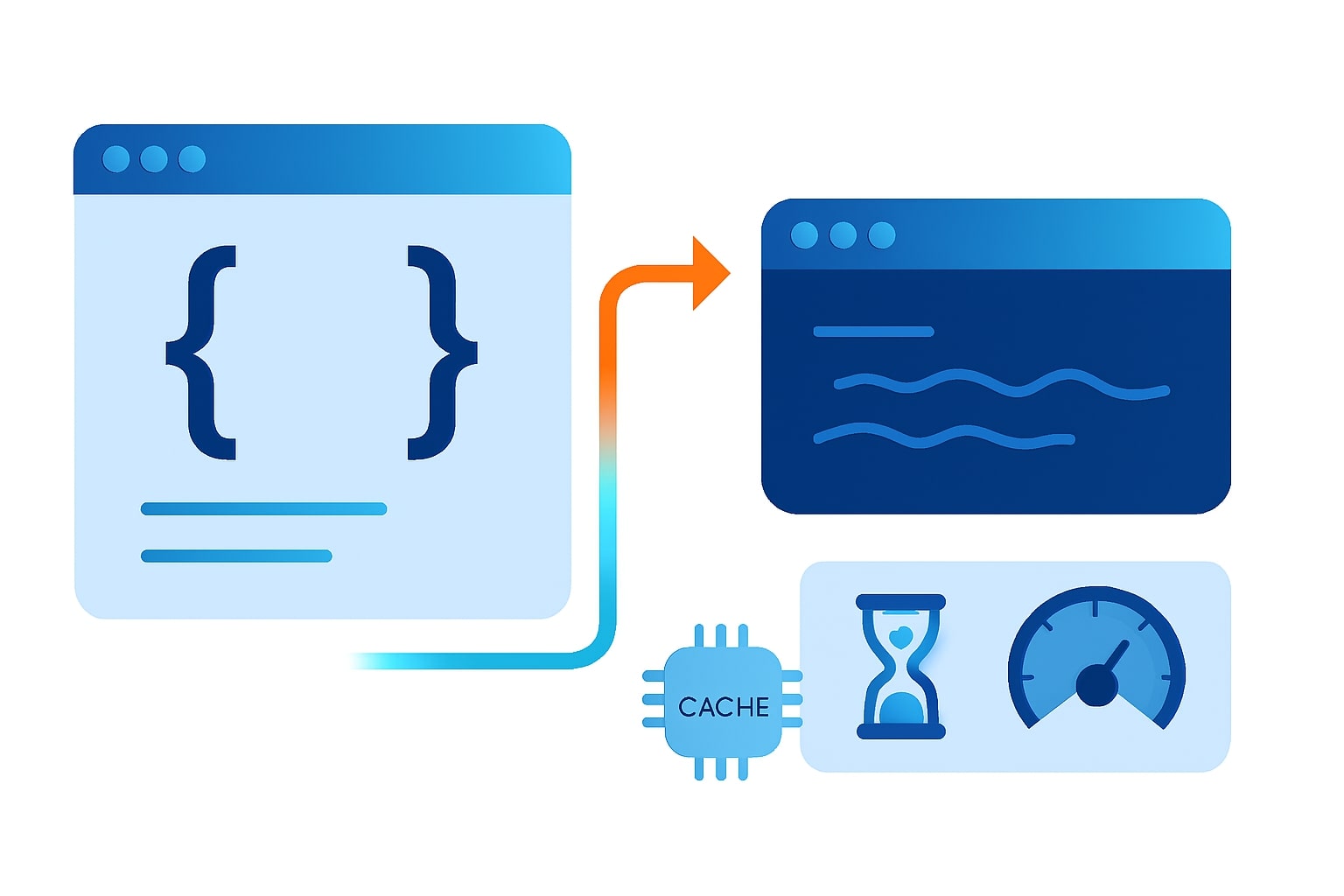

Desain prompt agar dapat diskon cached input

Prompt caching bekerja otomatis, Anda tidak perlu parameter khusus. Agar sering mengenai cache, pertahankan awalan instruksi yang panjang dan stabil, letakkan konten yang berubah di bagian akhir, jaga panjang awalan di atas sekitar seribu dua puluh empat token. Cache biasanya bertahan beberapa menit, jadi batch permintaan yang serupa dalam satu gelombang.

Kendalikan panjang keluaran

Di Responses API, gunakan max_output_tokens untuk membatasi panjang jawaban, padukan dengan stop bila Anda perlu memotong di akhir pola tertentu. Ini membantu mengendalikan biaya dan latensi, terutama saat membuat laporan panjang.

Router model dengan token budgeting

Agar biaya dan latensi terkendali, rancang pemilihan model yang sadar konteks dan sadar anggaran. Pendekatan sederhana berikut cukup kuat untuk produksi awal, gunakan perkiraan token konservatif, rute tugas ringan ke nano, mayoritas ke mini, dan cabang sulit ke gpt-5.

// heuristik ringan untuk estimasi token, 1 token ≈ 4 karakter Latin

const estimateTokens = (s: string) => Math.ceil((s?.length ?? 0) / 4)

type Complexity = 'low' | 'medium' | 'high'

type RoutingInput = {

prompt: string,

hasTools?: boolean,

complexity?: Complexity,

latencyTolerance?: 'low' | 'medium' | 'high',

expectedOutputTokens?: number

}

type Choice = { model: 'gpt-5' | 'gpt-5-mini' | 'gpt-5-nano', reasoningEffort: 'minimal' | 'medium' | 'high', maxOutputTokens: number }

function chooseModel(input: RoutingInput): Choice {

const inTok = estimateTokens(input.prompt)

const outTok = input.expectedOutputTokens ?? 400

const complexity = input.complexity ?? 'medium'

const latency = input.latencyTolerance ?? 'medium'

// cepat untuk kasus real time

if (latency === 'low' && complexity !== 'high') {

return { model: 'gpt-5-nano', reasoningEffort: 'minimal', maxOutputTokens: outTok }

}

// cabang sulit, gunakan model utama dengan penalaran sedang atau tinggi

if (complexity === 'high' || input.hasTools) {

return { model: 'gpt-5', reasoningEffort: complexity === 'high' ? 'high' : 'medium', maxOutputTokens: outTok }

}

// mayoritas tugas jatuh ke mini, kualitas baik dengan biaya stabil

const totalTok = inTok + outTok

if (totalTok <= 8000) {

return { model: 'gpt-5-mini', reasoningEffort: 'minimal', maxOutputTokens: outTok }

}

// fallback jika input sangat panjang atau laporan besar

return { model: 'gpt-5', reasoningEffort: 'medium', maxOutputTokens: outTok }

}

// pemakaian

const choice = chooseModel({

prompt: userPrompt,

hasTools: needsWeather || needsDB,

complexity: 'medium',

latencyTolerance: 'medium',

expectedOutputTokens: 600

})

const resp = await client.responses.create({

model: choice.model,

reasoning: { effort: choice.reasoningEffort },

input: [

{ role: 'system', instructions: 'Anda adalah asisten yang teliti' },

{ role: 'user', content: userPrompt }

],

max_output_tokens: choice.maxOutputTokens

})

Catatan routing yang praktis

• Ukur, jangan menebak. Log pilihan model, input tokens, output tokens, latensi, dan tingkat koreksi manual.

• Terapkan batas keluaran berbeda per model, mini dan nano biasanya cukup dengan keluaran pendek.

• Untuk batch besar dengan instruksi serupa, manfaatkan cached input agar biaya turun signifikan.

Demo stream ke UI Next.js

Contoh minimal untuk App Router. Endpoint server mengalirkan event Responses API apa adanya, komponen klien menampilkan delta teks saat tiba.

app/api/ai/route.ts

import { NextRequest } from 'next/server'

import OpenAI from 'openai'

export async function POST(req: NextRequest) {

const { prompt } = await req.json()

const openai = new OpenAI()

const stream = await openai.responses.create({

model: 'gpt-5-mini',

input: prompt,

stream: true

})

const encoder = new TextEncoder()

const readable = new ReadableStream({

async start(controller) {

try {

for await (const ev of stream) {

if (ev.type === 'response.output_text.delta') {

controller.enqueue(encoder.encode(ev.delta))

}

if (ev.type === 'response.completed') {

controller.close()

}

}

} catch (e) {

controller.error(e)

}

}

})

return new Response(readable, { headers: { 'Content-Type': 'text/plain; charset=utf-8' } })

}

app/page.tsx

'use client'

import { useState } from 'react'

export default function Page() {

const [prompt, setPrompt] = useState('Jelaskan prinsip idempotensi pada API')

const [text, setText] = useState('')

const [loading, setLoading] = useState(false)

async function run() {

setText('')

setLoading(true)

const res = await fetch('/api/ai', { method: 'POST', body: JSON.stringify({ prompt }) })

const reader = res.body?.getReader()

const decoder = new TextDecoder()

while (true) {

const { value, done } = await reader.read()

if (done) break

setText(t => t + decoder.decode(value))

}

setLoading(false)

}

return (

<main className="max-w-2xl mx-auto p-6 space-y-4">

<textarea value={prompt} onChange={e => setPrompt(e.target.value)} className="w-full h-32 border rounded p-3" />

<button onClick={run} disabled={loading} className="px-4 py-2 rounded bg-blue-600 text-white">

{loading ? 'Memproses...' : 'Kirim dan Stream'}

</button>

<pre className="whitespace-pre-wrap border rounded p-3 min-h-[160px]">{text}</pre>

</main>

)

}

Diagram arsitektur rute nano, mini, gpt-5

Gambaran sederhana ini membantu tim memahami aliran keputusan tanpa harus membuka kode. Anda bisa mengubahnya menjadi diagram visual, namun sketsa tekstual sudah cukup untuk menyepakati garis besar.

[Request pengguna]

│

[Preprocess, validasi, redaksi PII]

│

[Router]

├─ kondisi, latensi rendah dan kompleksitas rendah → gpt-5-nano

├─ kondisi, default mayoritas kasus → gpt-5-mini

└─ kondisi, kompleksitas tinggi atau butuh alat → gpt-5 dengan reasoning medium atau high

│

[Tool calling]

│

[Aggregator]

│

[Logging dan Metrics Store, latency, tokens, model, keberhasilan]

Catatan singkat, simpan sinyal yang Anda pakai untuk routing, panjang input, kebutuhan alat, tingkat ketidakpastian dari prompt, dan gunakan lagi sinyal tersebut untuk evaluasi agar model policy Anda dapat ditingkatkan berdasarkan data, bukan tebakan.

Middleware logging dan metrik operasional

Anda tidak perlu sistem observabilitas yang rumit untuk mulai mendapatkan manfaat. Mulailah dari kolektor sederhana yang menyimpan model, jumlah token, latensi, serta identitas permintaan untuk keperluan audit. Di bawah ini contoh pembungkus panggilan yang mencatat metrik penting, gunakan penyimpanan apa pun yang tersedia, database, data warehouse, atau log terstruktur.

type Metrics = {

id?: string,

model: string,

inputTokens?: number,

outputTokens?: number,

latencyMs: number,

success: boolean,

toolCalls?: number

}

async function callWithMetrics(prompt: string, choice: Choice) {

const t0 = Date.now()

try {

const res = await client.responses.create({

model: choice.model,

reasoning: { effort: choice.reasoningEffort },

input: [

{ role: 'system', instructions: 'Anda adalah asisten yang teliti' },

{ role: 'user', content: prompt }

],

max_output_tokens: choice.maxOutputTokens

})

const latencyMs = Date.now() - t0

const usage: any = (res as any).usage ?? {}

const outputs: any[] = Array.isArray((res as any).output) ? (res as any).output : []

const toolCalls = outputs.filter(o => o.type === 'tool_call').length

const reqId = (res as any)._request_id || (res as any).id

const m: Metrics = {

id: reqId,

model: choice.model,

inputTokens: usage.input_tokens,

outputTokens: usage.output_tokens,

latencyMs,

success: true,

toolCalls

}

await collector.save(m)

return res

} catch (e: any) {

const latencyMs = Date.now() - t0

await collector.save({ model: choice.model, latencyMs, success: false })

throw e

}

}

Jika Anda memakai Next.js API Route atau Express, tambahkan pencatat latensi di sekitar handler agar Anda bisa membandingkan latensi end to end dengan latensi API, perbedaan di antara keduanya sering kali menunjukkan penundaan pada jaringan internal atau logika tambahan di server Anda.

// contoh pola sederhana untuk mencatat latensi handler

export default async function handler(req, res) {

const t0 = Date.now()

try {

const out = await callWithMetrics(req.body.prompt, chooseModel({ prompt: req.body.prompt }))

res.status(200).json({ text: out.output_text })

} finally {

const latencyMs = Date.now() - t0

console.log('latency end to end', latencyMs)

}

}

Limit, kebijakan, dan realita lapangan

Di ChatGPT, tiap tier memiliki batas pesan per jendela waktu. Bagi pengguna berbayar, Anda mendapatkan kuota yang jauh lebih longgar, dan Anda bisa memilih Thinking atau Thinking Pro sesuai kebutuhan. Jika batas tercapai, percakapan akan bergeser ke varian mini hingga kuota kembali. Di sisi gratis, jatah Thinking biasanya sangat terbatas per hari. Rolllout bisa bertahap per wilayah dan perangkat, jadi wajar jika tim Anda menerima fitur di hari yang berbeda.

Di API, Anda berurusan dengan batas lain, jumlah permintaan per menit, token per menit, serta batas panjang permintaan dan keluaran. Keluarga GPT-5 mendukung konteks hingga sekitar empat ratus ribu token dan keluaran hingga sekitar seratus dua puluh delapan ribu token. Namun, kemampuan aplikasi Anda bergantung pada cara Anda menata cache, memotong konteks, dan mengatur batch. Untuk streaming, Responses API mengirim event semantik yang mudah dipilah, Anda bisa memanen output_text dengan aman setelah seluruh alur selesai.

Baca artikel menarik lainnya: GPT-5 vs Claude Opus 4.1: Pertarungan AI Terbaru untuk Bisnis Indonesia 2025 – Mana yang Lebih Menguntungkan untuk Budget Anda?

Pengendalian biaya tanpa mengorbankan kualitas

Biaya memiliki dua sisi yang harus Anda awasi, pemakaian token input dan output. Harga per satu juta token berbeda antar ukuran, gpt-5 berada di kelas tertinggi, gpt-5-mini menengah, gpt-5-nano paling hemat. Cached input memberi diskon besar untuk masukan yang berulang, misalnya template instruksi yang sama di ribuan permintaan. Dalam desain sistem, saya biasanya melakukan tiga hal sederhana, ringkas instruksi yang benar benar penting, pakai skema Structured Outputs agar parsing tidak mubazir, dan rute tugas ringan ke mini atau nano, sisakan gpt-5 untuk cabang yang sulit.

Pola implementasi yang tahan banting

Saya melihat tiga pola yang konsisten bekerja baik di GPT-5.

Pertama, router internal aplikasi. Buat logika sederhana yang mengevaluasi sinyal kompleksitas, panjang input, dan kebutuhan alat, lalu rute ke nano, mini, atau gpt-5. Ini cermin dari cara ChatGPT mengatur pengalaman, hanya saja Anda pegang kendali penuh.

Kedua, planner dan executor yang saling memeriksa. Gunakan gpt-5 sebagai perencana yang menulis langkah kerja dan kriteria selesai, jalankan eksekusi dengan mini untuk langkah yang deterministik, lalu minta gpt-5 meninjau hasil akhir. Kombinasi ini menahan biaya, sambil tetap menjaga akurasi di tahap yang kritis.

Ketiga, verifikasi ringan. Untuk keputusan yang sensitif, minta model menyatakan asumsi dan tingkat keyakinan, lalu bandingkan dengan aturan bisnis Anda. Jika skor keyakinan di bawah ambang, kirim ke jalur manual atau minta Thinking menelusuri ulang. Pendekatan ini menurunkan kejutan di produksi tanpa menghambat laju pengembangan.

Masalah umum yang sering muncul, dan cara meredakannya

Ketika latensi naik tiba tiba, periksa dulu apakah reasoning effort Anda tidak sengaja naik karena konfigurasi yang berubah, atau ada fungsi yang berulang kali dipanggil. Ketika parsing rusak, lihat kembali skema Structured Outputs, pastikan properti wajib, tipe data, dan contoh sudah jelas. Ketika biaya melompat, audit porsi output, laporan panjang yang tidak perlu sering kali yang paling mahal, set batas maksimum keluaran yang masuk akal, dan pecah laporan menjadi ringkasan yang bisa diperluas saat diperlukan.

Baca artikel menarik lainnya: Cara Mengoptimalkan Prompt ChatGPT, Gemini, dan Claude: Rahasia Tingkatkan Performa AI untuk Hasil Lebih Akurat

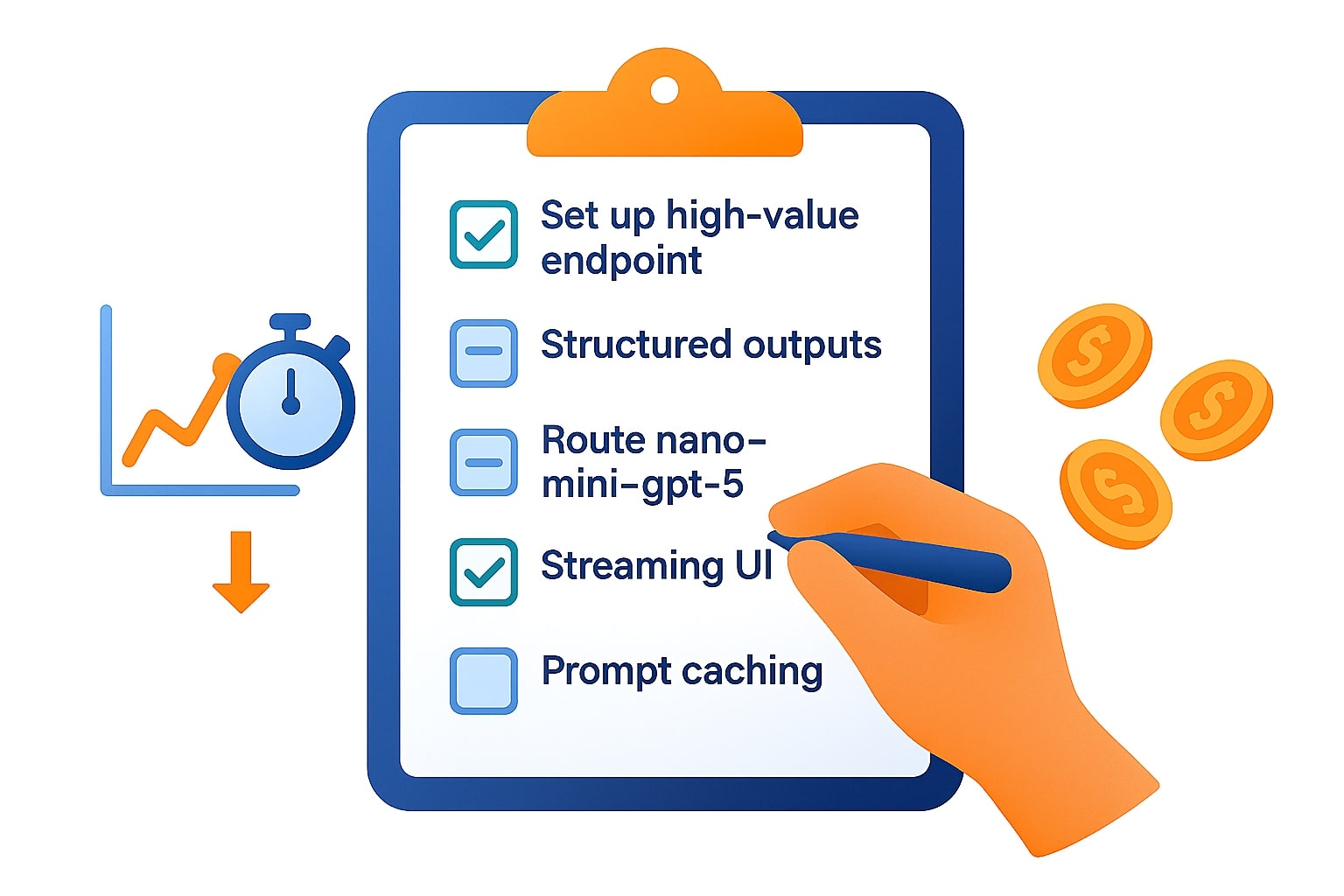

Apa yang sebaiknya Anda jalankan

Anda sudah melihat jalur dari ChatGPT ke API, parameter krusial, routing, streaming, dan observabilitas. Sekarang saatnya menerjemahkannya menjadi langkah kecil yang terukur. Mulai dari satu endpoint bernilai tinggi, tetapkan metrik yang ingin Anda tekan, lalu iterasikan cepat berdasarkan data.

Rangkuman eksekusi singkat

• Pasang GPT-5 di satu endpoint bernilai tinggi, ukur latensi, biaya, dan tingkat koreksi manual per seratus permintaan, gunakan data ini untuk mengatur ulang parameter

• Gunakan Structured Outputs untuk format yang stabil, kurangi parsing rapuh dan error hilir

• Terapkan routing sadar anggaran, nano untuk tugas ringan real time, mini untuk mayoritas pipeline, gpt-5 untuk cabang sulit dan evaluasi akhir

• Atur penalaran sesuai tugas, mulai dari medium untuk publik, turunkan ke minimal untuk tugas deterministik, naikkan ke high ketika kasusnya benar benar sukar

• Kendalikan panjang keluaran dengan max_output_tokens dan manfaatkan streaming agar UX responsif tanpa menambah biaya berlebihan

• Kunci penghematan ada pada prompt caching, jaga awalan instruksi yang stabil dan batch permintaan yang serupa

Pada akhirnya, yang membuat sistem Anda mampu bertahan lama bukan sihir model, melainkan disiplin mengukur, memperbaiki, dan menutup umpan balik. Dengan ritme ini, Anda menjaga biaya tetap terkendali, menjaga latensi tetap ramah pengguna, dan tetap mendapatkan kualitas yang dibutuhkan untuk sistem yang berjalan setiap hari. Jika ada pertanyaan atau ingin berbagi praktik terbaik, silakan tinggalkan komentar atau hubungi saya melalui halaman kontak atau tombol Let’s Chat.

Catatan kaki, Sumber data

1, OpenAI, Reasoning models

2. OpenAI, Structured model outputs

3. OpenAI, Function calling

4. OpenAI, Streaming responses

5. OpenAI, Using GPT-5, reasoning.effort dan praktik API

6. OpenAI, GPT-5 System Card, router waktu nyata dan arsitektur terpadu

7. OpenAI, GPT-5 System Card, PDF

Siap menerapkan ini untuk bisnis kamu?

Mari Diskusi →